Seedance 2.0

Seedance 2.0是ByteDance(TikTok 的创建者)推出的Seedance视频模型的开创性迭代。该模型侧重于为创作者提供对最终结果的非常精细的“导演级”控制。凭借其多模态架构,您可以使用文本、图像、现有视频和音频文件的组合来“导演”场景。请在下方试用Seedance 2.0 !

Seedance 2.0的主要功能

- 多模态 AI 视频创作:上传文本、图片、视频或音频来生成视频

- 高度可控的摄像机移动和运动:灵活控制摄像机的行为和运动

- 视频扩展流畅且一致:将现有视频扩展为更长的多镜头叙事。

- 改进音频生成:生成与生成的视频同步的原生高清音频

多模态AI视频创作

这是该模型的显著特征。每次生成最多可上传 12 个参考文件,并在提示中使用“@”标签为它们分配特定角色。例如,您可以上传:

- 图像(最多9张):用于锁定角色身份(例如,“@Image1是主角”)或定义特定的背景或光照风格。

- 视频参考(最多 3 个):允许您“借鉴”动作或电影摄影。您可以上传 15 秒的片段,并告诉 AI 复制其摄像机移动或角色的特定编舞(如舞蹈或打斗场景)。

- 音频参考(最多 3 个):用于原生音频同步。AI 会分析音乐的节奏或语音文件的音素,以生成匹配的视觉效果和唇形同步。

| 输入 |  |  |  |  | |

| 提示 | 将@Video1中的主体替换为@Image1中的人物,并使用@Image1作为开场画面。该人物佩戴着虚拟科幻眼镜。Replicate@Video1中的摄像机运动——特写镜头,环绕拍摄——然后将视角从第三人称切换到角色的主观视角。摄像机“进入”AI眼镜,到达@Image2的深蓝色宇宙,几艘宇宙飞船出现并逐渐消失在远处。跟随宇宙飞船进入@Image3的像素化世界,低空飞越像素化森林,展示树木的生长模式。最后,摄像机向上倾斜并快速移动到@Image4的浅绿色纹理星球,最后以掠过星球表面结束。 | ||||

| 输出 | |||||

高度可控的摄像机运动和动作

Seedance 2.0允许您通过上传现有视频剪辑作为“动作模板”来引导摄像机行为和动作。通过在提示中使用 @video 标签,您可以精确复制复杂电影摄影——例如希区柯克变焦、轨道镜头和甩镜头——或将参考视频中的复杂编舞映射到新的 AI 角色上。

Seedance 2.0还具有物理感知功能。它确保重力、动量和材料交互(如流动的织物或液体)表现得真实。

示例 1:

| 输入 |  |  |  | |

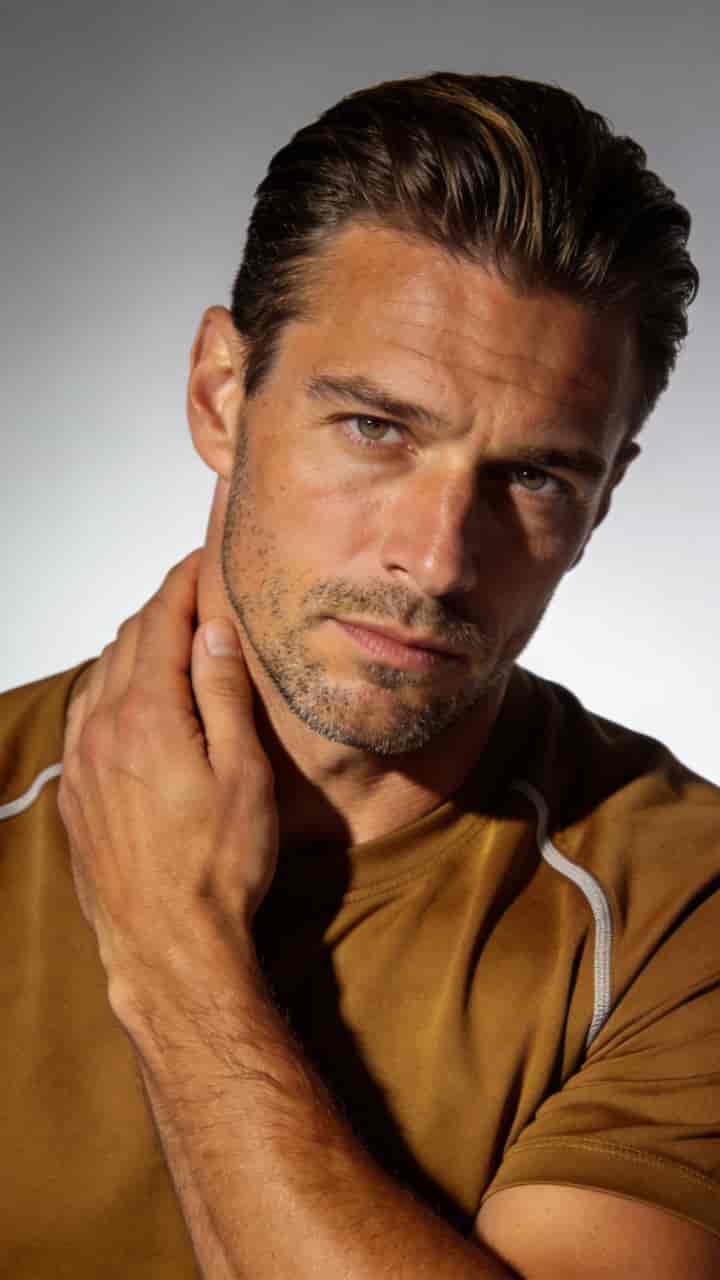

| 提示 | 参考@Image1中男子的外貌,他位于@Image2中的电梯内。完全复制@Video1中的所有摄像机运动和主角的面部表情。当主角感到恐惧时,执行希区柯克变焦(推拉变焦),然后进行几次环绕镜头,以显示电梯内的视角。当电梯门打开时,使用跟拍镜头跟踪他走出电梯。电梯外的场景应参考@Image3。当男子环顾四周时,使用机械臂式的多角度镜头跟随他的视线,如@Video1所示。 | |||

| 输出 | ||||

示例 2:

| 输入 |  |  | ||

| 提示 | 根据@Image1和@Image2中的角色,参考@Video1中的角色动作和@Video2中的环绕摄像机语言,生成一场打斗场景。战斗发生在星光灿烂的夜空下,交手时会扬起白色尘土。打斗编排极其华丽,视觉效果惊人,气氛紧张。 | |||

| 输出 | ||||

流畅且一致的视频扩展

Seedance 2.0允许您将现有视频扩展为更长的多镜头叙事,同时保持完美的时空逻辑。AI 模型可以将角色的外观、环境的照明和整体电影风格投射到下一个序列中,从而防止早期模型中常见的“视觉漂移”。

| 输入视频 | 提示 | 输出 |

| 将@Video1延长15秒。1-5秒:光线和阴影透过百叶窗缓慢地滑过木桌和杯子的表面,树枝以轻柔、有节奏的“呼吸”动作摇摆。6-10秒:一颗咖啡豆从画面顶部飘落;镜头向前推近咖啡豆,直到屏幕完全变黑。11-15秒:英文文字逐渐淡入:第一行“Lucky Coffee”,第二行“Breakfast”,第三行“AM 7:00-10:00”。 | ||

| 在视频开头加上10秒。温暖的午后阳光下,镜头从街角一行在微风中飘动的遮阳篷开始,然后慢慢向下倾斜,对准墙根下探出头来的几朵雏菊。接着,主角的红色运动鞋出现在画面中;他蹲在路边的一个花摊前,微笑着将一大束向日葵抱在怀里,花瓣蹭过他的白色T恤。当他转身准备踏上滑板时,摊主笑着喊道:“小心,花瓣要飞了!”他向摊主挥了挥手,然后开始滑走。几片金色的花瓣已经从花束中脱落,落在了他的滑板上。 |

改进音频生成

Seedance 2.0引入了一项功能,可在单次传递中同时生成原生、高保真音频和视频,确保完美同步。它能以超过 8 种语言创建音素级别的唇形同步,并将环境音效直接与屏幕上的动作(如脚步声或玻璃破碎声)匹配。

| 输入图像 | 提示 | 输出 |

| 生成一个 15 秒的音乐视频。关键词:稳定的构图/微妙的推拉镜头/低角度英雄感/纪录片风格但高端。超广角镜头,低角度略微向上看,悬崖上的土路和一辆老式旅行车占据画面下方三分之一。远处的海洋和地平线营造出空间感。黄金时段的侧逆光,体积光穿过尘埃粒子。电影般的构图,真实的胶片颗粒感,微风吹拂着衣摆。 | |

| 固定镜头。一个身材魁梧的站立男子(队长)握紧拳头,手臂挥舞,用西班牙语喊道:“三分钟后突袭!”他旁边,一名队员将刀收回刀鞘;一名金发队员站着检查枪支,而一名绿发队员则紧握战术手电筒。一名黑人队员拍了拍同伴的肩膀,用西班牙语问道:“从侧翼包抄他们?”队长点点头,用西班牙语回答道:“标准程序,留他们活口以供审问。”所有人都保持着严肃。在装备叮当声中,他们完成了战术手势,然后整齐划一地站了起来,配合默契。每个人都已准备好战斗,包括左边两个年轻人,他们也赶紧站起来,渴望投入战斗。 |

Seedance 2.0与其他高级模型的比较

| 特色 | Seedance 2.0 | OpenAI Sora 2 | Google Veo 3.1 |

| 最大分辨率 | 2K | 1080p | 4K |

| 输入 | 文本、图像、视频、音频 | 文本、图像 | 文本、图像 |

| 音频 | 原生(唇形同步 + 音效) | 本地 | 本地 |

| 速度 | 高(比 v1.5 快约 30%) | 中等 | 中等 |

| 控制 | 总监级别(多职位参考) | 基于提示的 | 基于提示的 |

如何在HIX AI上使用Seedance 2.0 ?

提交您的意见

输入文本提示,或上传图片、视频剪辑或音频文件。

创建您的视频

开始生成视频,很快就能获得输出结果。

关于Seedance 2.0 的YouTube视频

Reddit上关于Seedance 2.0 的帖子

X 帖子:关于Seedance 2.0

首次测试Seedance 2.0!

— Dinda Prasetyo (@heydin_ai) 2026年2月10日

根据我的初步测试,这是我目前尝试过的最令人印象深刻的AI视频模型之一。

动态运动感觉流畅,提示响应迅速,效率非常突出,几乎不需要迭代。

您在这里看到的一切都是生成的…… https://t.co/2W1VSEWb96 pic.twitter.com/Wx83V4aXzb

seedance 2.0 是唯一一款让我感到害怕的模型。

— el.cine (@EHuanglu) 2026年2月8日

电影行业里几乎所有的工作都将不复存在,你上传一个剧本,它就能生成带有视觉特效、配音、音效、音乐的场景(不仅仅是片段),而且所有这些都经过了精心的剪辑,我们甚至可能不再需要剪辑师了。

现在我明白了为什么不是这样…… https://t.co/YUQAYuMhh8 pic.twitter.com/UYsP5fGMo6

人工智能越来越疯狂了。

— Min Choi (@minchoi) 2026年2月10日

Seedance 2.0刚刚发布了 🤯 https://t.co/lllaMqS6Wj pic.twitter.com/Z7d3hqGN37

过去三天, Seedance 2.0一直占据我的时间线。它尚未公开发布,但ByteDance显然计划在 2 月 24 日发布 API。许多早期访问用户正在展示动漫制作方面取得的惊人进展。汇编帖: https://t.co/tFuJuLHL43

——安德鲁·柯伦 (@AndrewCurran_) 2026年2月10日

中国的Seedance 2.0刚刚火爆全网。

— AI Highlight (@AIHighlight) 2026年2月9日

人们已经用它来制作短片、动画和电影般的镜头。

10个疯狂的例子:

1. 好莱坞完蛋了。🤯

pic.twitter.com/qiBNrPmDqS

🇳🇱🗽 这是@BytedanceTalk的Seedance 2.0 ,以及我的新阿姆斯特丹(现在的纽约市)模拟器提示

— @levelsio (@levelsio) 2026年2月11日

与之前的模型(如Seedance 1.5,它会添加看起来不像荷兰风车的风车)不同,它真实准确地描绘了 1670 年的城市风貌。

这太…… https://t.co/yyeZgGNR0l pic.twitter.com/46sHAUlQa9

这是我的第一代Seedance 2.0 。另外,每个人都想玩得开心,所以别再把这些东西藏着掖着了,直接去这里生成就行。用谷歌账号登录。如果你解开了一个谜题,你就登录成功了,因为即使它要求你验证一个数字,只要刷新页面就行了…… pic.twitter.com/2fqiMqNPMG

— Travis Davids (@MrDavids1) 2026年2月10日

使用Seedance 2.0在 30 分钟内完成。

— Rayleigh_AI (@Long4AI) 2026年2月8日

我们正在进入一个人就能拍电影的时代。pic.twitter.com /Txpc83FRcM

Seedance 2.0真正改变了 AI 视频生成的规则。我制作了很多Sora 2视频,我可以肯定地说, Seedance 2.0 的效果绝对更好,而且更加连贯。很快,每一部卡通片或动画片都将以更短的时间和更低的成本通过 AI 制作! https://t.co/PtDjFSVZK6

— Derya Unutmaz,医学博士 (@DeryaTR_) 2026年2月11日

为什么没人谈论这个 Seedance 2.0 功能有多么疯狂……

— Miko (@Mho_23) 2026年2月10日

您可以附加多个图像、视频和音频片段,作为单次生成的参考。

这意味着您可以重现互联网上任何视频的剪辑风格和视频风格。

查找… pic.twitter.com/uA7vyUUDcL

常见问题解答

Seedance 2.0是什么时候发布的?

Seedance 2.0于2026年2月正式推出,标志着从实验性AI剪辑到专业、可投入生产的工作流程的重大转变。

Seedance 2.0的最大分辨率和时长是多少?

Seedance 2.0可以生成高达原生 2K (2048x1080) 的视频,提供电影级画质,且没有升频伪影。其输出片段通常为 4-15 秒,但可以延长至 60 秒。

Seedance 2.0能否在不同片段中保持角色一致性?

是的,该模型可确保面部、头发和服装在多代或扩展序列中保持一致。

我可以用Seedance 2.0编辑现有的视频吗?

是的。Seedance Seedance 2.0支持视频到视频编辑。您可以上传一段视频,并使用文本提示来更改特定元素(例如,“将角色的服装更改为宇航服”),同时保持原始动作和摄像机工作不变。

使用Seedance 2.0生成的速度有多快?

Seedance 2.0针对速度进行了优化,性能比 1.5 版本快约 30%。标准的 5 秒高质量片段通常在 60 秒内生成。

Seedance 2.0能否准确渲染文本(徽标、标志)?

虽然文本渲染有所改进,但仍然是一个挑战。简单的、大尺寸的文本可能有效,但复杂的徽标或小字体的标志仍然可能出现“乱码”。