Seedance 2.0

Seedance 2.0 ist eine bahnbrechende Weiterentwicklung des Seedance -Videomodells von ByteDance (den Machern von TikTok). Dieses Modell ermöglicht Kreativen eine präzise Kontrolle über das Endergebnis. Dank seiner multimodalen Architektur können Sie eine Szene mithilfe von Text, Bildern, bestehenden Videos und Audiodateien gestalten. Testen Sie Seedance 2.0 gleich hier!

Hauptmerkmale von Seedance 2.0

- Multimodale KI-Videoerstellung: Laden Sie Text, Bilder, Videos oder Audiodateien hoch, um Videos zu generieren.

- Hochgradig kontrollierbare Kamerabewegung und -steuerung: Kameraverhalten und -bewegung flexibel steuern

- Reibungslose und konsistente Videoerweiterung: Bestehende Videos zu längeren, aus mehreren Einstellungen bestehenden Erzählungen erweitern

- Verbesserte Audiogenerierung: Erzeugt nativen HD-Audio, der mit dem generierten Video synchronisiert ist.

Multimodale KI-Videoerstellung

Dies ist das charakteristische Merkmal des Modells. Sie können bis zu 12 Referenzdateien pro Generation hochladen und mithilfe von „@“-Tags in Ihrer Eingabeaufforderung diesen Dateien bestimmte Rollen zuweisen. Zum Beispiel können Sie Folgendes hochladen:

- Bilder (bis zu 9): Werden verwendet, um die Identität einer Figur festzulegen (z. B. „@Bild1 ist der Protagonist“) oder um einen bestimmten Hintergrund- oder Beleuchtungsstil zu definieren.

- Videoreferenzen (bis zu 3): Ermöglicht das „Stehlen“ von Bewegungen oder Kameraeinstellungen. Sie können einen 15-sekündigen Clip hochladen und die KI anweisen, dessen Kamerabewegung oder die Choreografie einer Figur (z. B. eine Tanz- oder Kampfszene) nachzubilden.

- Audio-Referenzen (bis zu 3): Werden für die native Audio-Synchronisierung verwendet. Die KI analysiert den Rhythmus der Musik oder die Phoneme einer Sprachdatei, um passende visuelle Elemente und Lippensynchronisation zu generieren.

| Eingaben |  |  |  |  | |

| Prompt | Ersetzen Sie die Person in @Video1 durch die Person aus @Image1 und verwenden Sie @Image1 als Anfangsbild. Die Person trägt eine virtuelle Science-Fiction-Brille. Replicate die Kamerabewegung aus @Video1 – eine kreisende Nahaufnahme – und wechseln Sie dann von der Außenperspektive zur subjektiven Sicht der Figur. Die Kamera „tritt“ in die KI-Brille ein und gelangt in das tiefblaue Universum von @Image2, wo mehrere Raumschiffe erscheinen und in der Ferne verschwinden. Folgen Sie den Raumschiffen in die pixelige Welt von @Image3 und fliegen Sie in geringer Höhe über einen pixeligen Wald, um die Wachstumsmuster der Bäume zu zeigen. Neigen Sie die Kamera schließlich nach oben und bewegen Sie sie schnell auf den hellgrünen, texturierten Planeten von @Image4 zu, um mit einem kurzen Flug über die Planetenoberfläche zu enden. | ||||

| Ausgabe | |||||

Hochgradig kontrollierbare Kamerabewegung und -steuerung

Seedance 2.0 ermöglicht es Ihnen, Kameraverhalten und -bewegungen zu steuern, indem Sie vorhandene Videoclips als „Bewegungsvorlagen“ hochladen. Durch die Verwendung des @video-Tags in Ihrer Anweisung können Sie komplexe Kameraeinstellungen – wie Hitchcock-Zooms, Orbit-Shots und Schwenks – präzise nachbilden oder aufwendige Choreografien aus einem Referenzvideo auf eine neue KI-Figur übertragen.

Seedance 2.0 berücksichtigt zudem physikalische Prinzipien. Es stellt sicher, dass sich Schwerkraft, Impuls und Materialinteraktionen (wie fließende Stoffe oder Flüssigkeiten) realistisch verhalten.

Beispiel 1:

| Eingaben |  |  |  | |

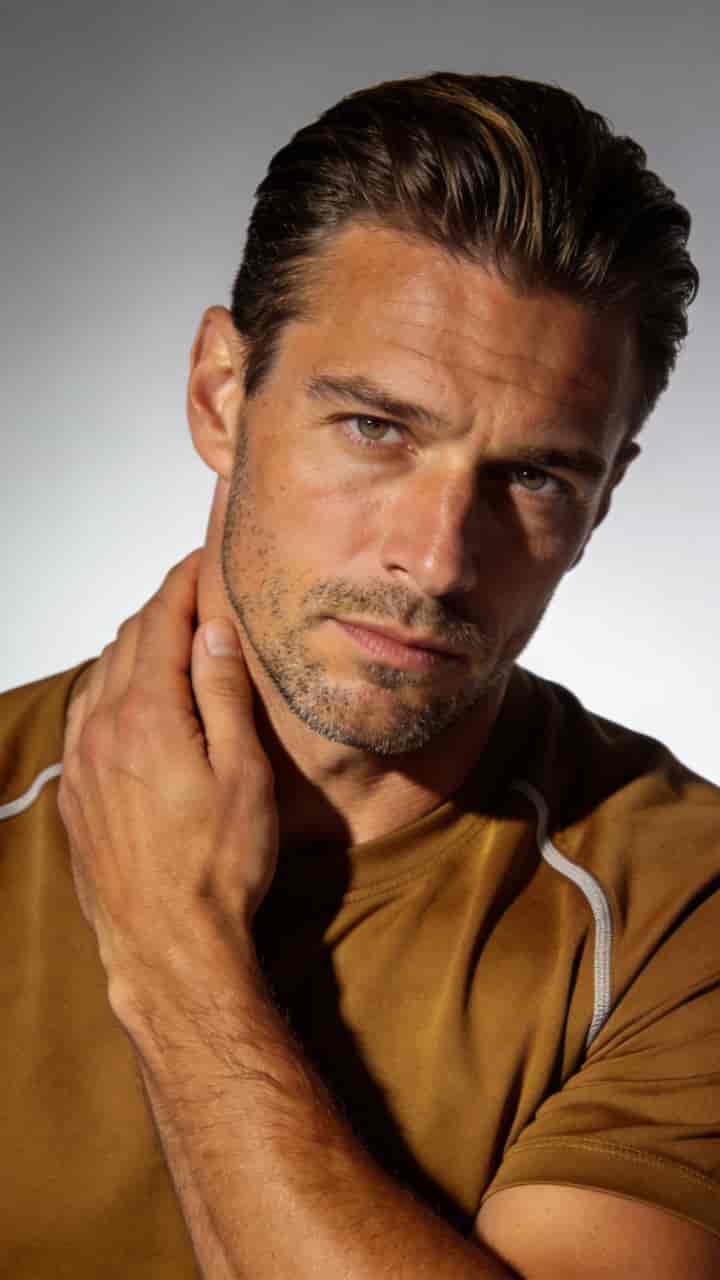

| Prompt | In Anlehnung an das Aussehen des Mannes in @Image1 befindet er sich im Aufzug aus @Image2. Alle Kamerabewegungen und Gesichtsausdrücke des Protagonisten aus @Video1 sind exakt nachzubilden. Wenn der Protagonist Angst hat, ist ein Hitchcock-Zoom (Dolly-Zoom) zu verwenden, gefolgt von mehreren kreisenden Einstellungen, um die Perspektive im Aufzug zu zeigen. Sobald sich die Aufzugtüren öffnen, ist eine Folgeaufnahme zu sehen, die den Mann beim Verlassen des Aufzugs verfolgt. Die Szene außerhalb des Aufzugs sollte sich an @Image3 orientieren. Während der Mann sich umsieht, sind, wie in @Video1 zu sehen, roboterarmartige Mehrwinkelaufnahmen zu verwenden, die seiner Blickrichtung folgen. | |||

| Ausgabe | ||||

Beispiel 2:

| Eingaben |  |  | ||

| Prompt | Erstelle eine Kampfszene zwischen den Charakteren aus @Image1 und @Image2, wobei du die Charakterbewegungen aus @Video1 und die kreisende Kameraführung aus @Video2 verwendest. Der Kampf findet unter einem sternenklaren Nachthimmel statt, wobei weißer Staub aufgewirbelt wird. Die Kampfchoreografie ist unglaublich extravagant und visuell beeindruckend, und die Atmosphäre ist extrem angespannt. | |||

| Ausgabe | ||||

Reibungslose und konsistente Videoerweiterung

Seedance 2.0 ermöglicht es Ihnen, bestehende Videos zu längeren, mehrteiligen Erzählungen zu erweitern und dabei die räumlich-zeitliche Logik perfekt beizubehalten. Das KI-Modell kann das Aussehen einer Figur, die Beleuchtung der Umgebung und den gesamten filmischen Stil in die nächste Sequenz übertragen und so das bei früheren Modellen häufig auftretende „visuelle Driften“ verhindern.

| Eingangsvideo | Prompt | Ausgabe |

| Verlängern Sie @Video1 um 15 Sekunden. 1–5 Sekunden: Licht und Schatten gleiten langsam durch Jalousien über einen Holztisch und die Oberfläche einer Tasse, während sich die Äste eines Baumes in einer sanften, rhythmischen Bewegung wiegen. 6–10 Sekunden: Eine einzelne Kaffeebohne schwebt vom oberen Bildrand herab; die Kamera zoomt auf die Bohne heran, bis der Bildschirm vollständig schwarz wird. 11–15 Sekunden: Englischer Text wird allmählich eingeblendet: erste Zeile „Lucky Coffee“, zweite Zeile „Breakfast“ und dritte Zeile „AM 7:00–10:00“. | ||

| Füge dem Video 10 Sekunden hinzu. Im warmen Nachmittagslicht beginnt die Kamera mit einer Reihe von Markisen an einer Straßenecke, die sich sanft im Wind wiegen. Langsam schwenkt sie nach unten zu ein paar Gänseblümchen, die zwischen einer Mauer hervorlugen. Dann erscheinen die roten Turnschuhe des Protagonisten im Bild; er hockt vor einem Blumenstand am Straßenrand und lächelt, während er einen großen Sonnenblumenstrauß in die Arme nimmt. Die Blütenblätter streifen sein weißes T-Shirt. Als er sich umdreht, um auf sein Skateboard zu steigen, ruft der Standbesitzer lächelnd: „Vorsicht, die Blütenblätter fliegen!“ Er winkt dem Besitzer zu, bevor er losfährt. Ein paar goldene Blütenblätter haben sich bereits vom Strauß gelöst und sind auf seinem Skateboard gelandet. |

Verbesserte Audiogenerierung

Seedance 2.0 ermöglicht die gleichzeitige Erzeugung von nativem, hochauflösendem Audio und Video in einem einzigen Durchgang und gewährleistet so eine perfekte Synchronisation. Es erzeugt eine Lippensynchronisation auf Phonemebene in über acht Sprachen und passt Umgebungsgeräusche direkt an Aktionen auf dem Bildschirm an, wie z. B. Schritte oder das Klirren von Glas.

| Eingabebild | Prompt | Ausgabe |

| Erstelle ein 15-sekündiges Musikvideo. Stichwörter: Stabile Bildkomposition / Subtiles Spiel von Spannung und Kontrast / Heroische Untersicht / Dokumentarisch und dennoch hochwertig. Ultraweite Einstellungsaufnahme, leicht nach oben gerichtete Untersicht, eine unbefestigte Straße an einer Klippe und ein Oldtimer-Kombi im unteren Drittel des Bildes. Das ferne Meer und der Horizont erzeugen ein Gefühl von Weite. Goldene Abendsonne mit Gegenlicht und volumetrischem Licht, das durch Staubpartikel fällt. Filmische Komposition, authentisches Filmkorn und eine sanfte Brise, die den Saum der Kleidung bewegt. | |

| Standbild. Ein stämmiger Mann (der Captain) ballt die Faust und ruft auf Spanisch: „Angriff in drei Minuten!“ Neben ihm steckt ein Kamerad sein Messer weg; ein blondes Mitglied überprüft seine Waffe, während ein grünhaariges Mitglied eine taktische Taschenlampe umklammert. Ein schwarzer Kamerad klopft einem anderen auf die Schulter und fragt auf Spanisch: „Flankieren?“ Der Captain nickt und antwortet auf Spanisch: „Standardprozedur, lasst sie am Leben für das Verhör.“ Alle bleiben ernst. Im Klirren ihrer Ausrüstung geben sie taktische Handzeichen und stehen synchron auf – perfekte Harmonie. Alle sind kampfbereit, auch zwei junge Männer links, die angriffslustig aufspringen. |

Vergleich von Seedance 2.0 und anderen fortgeschrittenen Modellen

| Besonderheit | Seedance 2.0 | OpenAI Sora 2 | Google Veo 3.1 |

| Maximale Auflösung | 2K | 1080p | 4K |

| Eingaben | Text, Bild, Video, Audio | Text, Bild | Text, Bild |

| Audio | Native (Lippensynchronisation + Soundeffekte) | Einheimisch | Einheimisch |

| Geschwindigkeit | Hoch (~30 % schneller als Version 1.5) | Mäßig | Mäßig |

| Kontrolle | Direktorenebene (Mehrfachreferenz) | Prompt-basiert | Prompt-basiert |

Wie verwende ich Seedance 2.0 auf HIX AI?

Wählen Sie das Seedance 2.0 -Modell

Gehen Sie zum HIX AI Video Generator und wählen Sie Seedance 2.0 aus.

Reichen Sie Ihre Eingabe ein

Geben Sie einen Text ein oder laden Sie Bilder, Videoclips oder Audiodateien hoch.

Erstellen Sie Ihr Video

Starten Sie Ihre Videogenerierung und erhalten Sie das Ergebnis in kurzer Zeit.

YouTube Videos über Seedance 2.0

Reddit -Beiträge über Seedance 2.0

X Beiträge über Seedance 2.0

ERSTER TEST Seedance 2.0!

– Dinda Prasetyo (@heydin_ai) 10. Februar 2026

Nach meinen ersten Tests ist dies eines der beeindruckendsten KI-Videomodelle, die ich bisher ausprobiert habe.

Die Bewegungsabläufe wirken flüssig, die prompte Umsetzung ist solide und die Effizienz stach besonders hervor; es waren nur sehr wenige Iterationen nötig.

Alles, was Sie hier sehen, wurde generiert… https://t.co/2W1VSEWb96 pic.twitter.com/Wx83V4aXzb

Seedance 2.0 ist das einzige Modell, das mir so große Angst macht.

– el.cine (@EHuanglu) 8. Februar 2026

Praktisch jeder Job in der Filmindustrie ist verschwunden. Man lädt ein Drehbuch hoch, und es werden Szenen (nicht nur Clips) mit visuellen Effekten, Sprachausgabe, Soundeffekten und Musik – alles professionell bearbeitet – generiert. Vielleicht brauchen wir nicht einmal mehr Cutter.

Und jetzt verstehe ich, warum es nicht so ist… https://t.co/YUQAYuMhh8 pic.twitter.com/UYsP5fGMo6

Die KI wird immer verrückter…

– Min Choi (@minchoi) 10. Februar 2026

Seedance 2.0 hat das gerade veröffentlicht 🤯 https://t.co/lllaMqS6Wj pic.twitter.com/Z7d3hqGN37

Seedance 2.0 war die letzten drei Tage ständig in meiner Timeline. Es ist noch nicht öffentlich zugänglich, aber ByteDance plant offenbar, die API am 24. Februar zu veröffentlichen. Viele der Gens aus dem Early Access zeigen die beeindruckenden Fortschritte bei Anime. Zusammenstellungsthread: https://t.co/tFuJuLHL43

— Andrew Curran (@AndrewCurran_) 10. Februar 2026

Chinas Seedance 2.0 hat das Internet lahmgelegt.

— AI Highlight (@AIHighlight) 9. Februar 2026

Es werden bereits Kurzfilme, Anime und filmische Aufnahmen damit erstellt.

10 unglaubliche Beispiele:

1. Hollywood ist am Ende. 🤯

pic.twitter.com/qiBNrPmDqS

🇳🇱🗽 Dies ist @BytedanceTalk 's Seedance 2.0 mit meiner New Amsterdam (heutiges New York City) Simulator-Aufforderung.

— @levelsio (@levelsio) 11. Februar 2026

Im Gegensatz zu früheren Modellen wie Seedance 1.5 (die Windmühlen hinzufügten, die nicht holländisch aussahen), stellt es die Stadt wirklich genau so dar, wie sie im Jahr 1670 war.

Es ist sehr… https://t.co/yyeZgGNR0l pic.twitter.com/46sHAUlQa9

Hier ist meine erste Seedance 2.0 Generierung. Jeder will Spaß haben, also hört auf, das Ganze zu blockieren! Geht einfach hierher und generiert. Meldet euch mit einem Google-Konto an. Wenn ihr ein Rätsel löst, seid ihr automatisch angemeldet. Selbst wenn ihr eine Zahl bestätigen müsst, aktualisiert einfach die Seite… pic.twitter.com/2fqiMqNPMG

— Travis Davids (@MrDavids1) 10. Februar 2026

Habe das in 30 Minuten mit Seedance 2.0 gemacht.

— Rayleigh_AI (@Long4AI) 8. Februar 2026

Wir treten in eine Ära ein, in der eine einzelne Person einen Film drehen kann. pic.twitter.com/Txpc83FRcM

Seedance 2.0 revolutioniert die KI-gestützte Videoerstellung. Ich erstelle viele Sora 2 -Videos und kann bestätigen, dass Seedance 2.0 deutlich besser und viel konsistenter aussieht. Schon bald werden alle Cartoons und Animationsserien mit KI in einem Bruchteil der Zeit und zu einem Bruchteil der Kosten erstellt! https://t.co/PtDjFSVZK6

– Derya Unutmaz, MD (@DeryaTR_) , 11. Februar 2026

Warum spricht niemand darüber, wie WAHNSINNIG diese Seedance 2.0-Funktion ist...?

– Miko (@Mho_23) 10. Februar 2026

Sie können mehrere Bilder, Videos und Audioclips als Referenz für eine einzelne Generation anhängen.

Das bedeutet, dass Sie den Bearbeitungs- und Videostil von buchstäblich jedem Video im Internet nachbilden können.

Finde… pic.twitter.com/uA7vyUUDcL

FAQs

Wann wurde Seedance 2.0 veröffentlicht?

Seedance 2.0 wurde offiziell im Februar 2026 eingeführt und markierte einen bedeutenden Wandel von experimentellen KI-Clips hin zu professionellen, produktionsreifen Arbeitsabläufen.

Was ist die maximale Auflösung und Laufzeit von Seedance 2.0?

Seedance 2.0 kann Videos in nativer 2K-Auflösung (2048x1080) erzeugen und bietet so Kinoqualität ohne Upscaling-Artefakte. Die Ausgabeclips sind typischerweise 4–15 Sekunden lang, können aber auf bis zu 60 Sekunden verlängert werden.

Kann Seedance 2.0 die Charakterkonsistenz über verschiedene Clips hinweg gewährleisten?

Ja, das Modell stellt sicher, dass Gesicht, Haare und Kleidung über mehrere Generationen oder längere Zeiträume hinweg einheitlich bleiben.

Kann ich bestehende Videos mit Seedance 2.0 bearbeiten?

Ja. Seedance 2.0 unterstützt Video-zu-Video-Bearbeitung. Sie können einen Clip hochladen und mithilfe von Textanweisungen bestimmte Elemente ändern (z. B. „Ändere die Kleidung der Figur in einen Raumanzug“), während die ursprüngliche Bewegung und Kameraführung erhalten bleiben.

Wie schnell erfolgt die Generierung mit Seedance 2.0?

Seedance 2.0 ist auf Geschwindigkeit optimiert und arbeitet etwa 30 % schneller als Version 1.5. Ein standardmäßiger, 5 Sekunden langer Clip in hoher Qualität wird in der Regel in unter 60 Sekunden generiert.

Kann Seedance 2.0 Text (Logos, Schilder) korrekt darstellen?

Die Textdarstellung wurde zwar verbessert, bleibt aber eine Herausforderung. Einfache, großformatige Texte funktionieren möglicherweise, aber komplexe Logos oder kleingedruckte Schilder können immer noch „verstümmelt“ erscheinen.