Seedance 2.0

Seedance 2.0 to przełomowa iteracja modelu wideo Seedance firmy ByteDance (twórcy TikToka). Model ten koncentruje się na zapewnieniu twórcom precyzyjnej kontroli nad efektem końcowym na poziomie reżysera. Dzięki multimodalnej architekturze możesz „wyreżyserować” scenę, łącząc tekst, obrazy, istniejące filmy i pliki audio. Wypróbuj Seedance 2.0 poniżej!

Kluczowe cechy Seedance 2.0

- Tworzenie multimodalnych filmów wideo przy użyciu sztucznej inteligencji: Prześlij tekst, obraz, wideo lub dźwięk, aby wygenerować filmy

- Wysoce kontrolowany ruch kamery: Elastyczne sterowanie zachowaniem i ruchem kamery

- Płynne i spójne rozszerzanie wideo: rozszerzać istniejące filmy o dłuższe, wieloujęciowe narracje

- Ulepszone generowanie dźwięku: Generuje natywny dźwięk HD zsynchronizowany z generowanym wideo

Tworzenie multimodalnych filmów AI

To jest definiująca cecha tego modelu. Możesz przesłać do 12 plików referencyjnych na generację i użyć znaczników „@” w monicie, aby przypisać im określone role. Na przykład, możesz przesłać:

- Obrazy (maksymalnie 9): służą do ustalenia tożsamości postaci (np. „@Image1 jest bohaterem”) lub zdefiniowania konkretnego tła lub stylu oświetlenia.

- Odniesienia wideo (maksymalnie 3): Pozwala „kraść” ruch lub zdjęcia. Możesz przesłać 15-sekundowy klip i polecić sztucznej inteligencji odtworzenie ruchu kamery lub konkretnej choreografii postaci (np. sekwencji tańca lub walki).

- Odniesienia audio (do 3): Używane do natywnej synchronizacji audio. Sztuczna inteligencja analizuje rytm muzyki lub fonemy pliku głosowego, aby generować dopasowane efekty wizualne i synchronizację ruchu warg.

| Wejścia |  |  |  |  | |

| Podpowiedź | Zastąp obiekt w @Video1 osobą z @Image1, używając @Image1 jako klatki początkowej. Osoba nosi wirtualne okulary science fiction. Replicate ruch kamery z @Video1 – ujęcie z bliska i w ruchu okrężnym – a następnie przełącz perspektywę z perspektywy trzeciej osoby na subiektywny punkt widzenia postaci. Kamera „wchodzi” w okulary AI, docierając do głębokiego, niebieskiego wszechświata @Image2, gdzie pojawia się kilka statków kosmicznych i znika w oddali. Podążaj za statkami kosmicznymi do pikselowego świata @Image3, lecąc na niskiej wysokości nad pikselowym lasem, aby pokazać wzory wzrostu drzew. Na koniec przechyl kamerę w górę i szybko przesuń ją w kierunku jasnozielonej planety o teksturze @Image4, kończąc przelotem po powierzchni planety. | ||||

| Wyjście | |||||

Wysoce kontrolowany ruch kamery

Seedance 2.0 pozwala sterować zachowaniem i ruchem kamery poprzez przesyłanie istniejących klipów wideo jako „szablonów ruchu”. Używając znacznika @video w monicie, możesz precyzyjnie replikować złożoną kinematografię – taką jak hitchcockowskie zoomy, ujęcia orbitalne i panoramy – lub mapować skomplikowaną choreografię z filmu referencyjnego na nową postać sterowaną przez sztuczną inteligencję.

Seedance 2.0 uwzględnia również prawa fizyki. Gwarantuje, że grawitacja, pęd i interakcje materiałów (np. płynącej tkaniny lub cieczy) zachowują się realistycznie.

Przykład 1:

| Wejścia |  |  |  | |

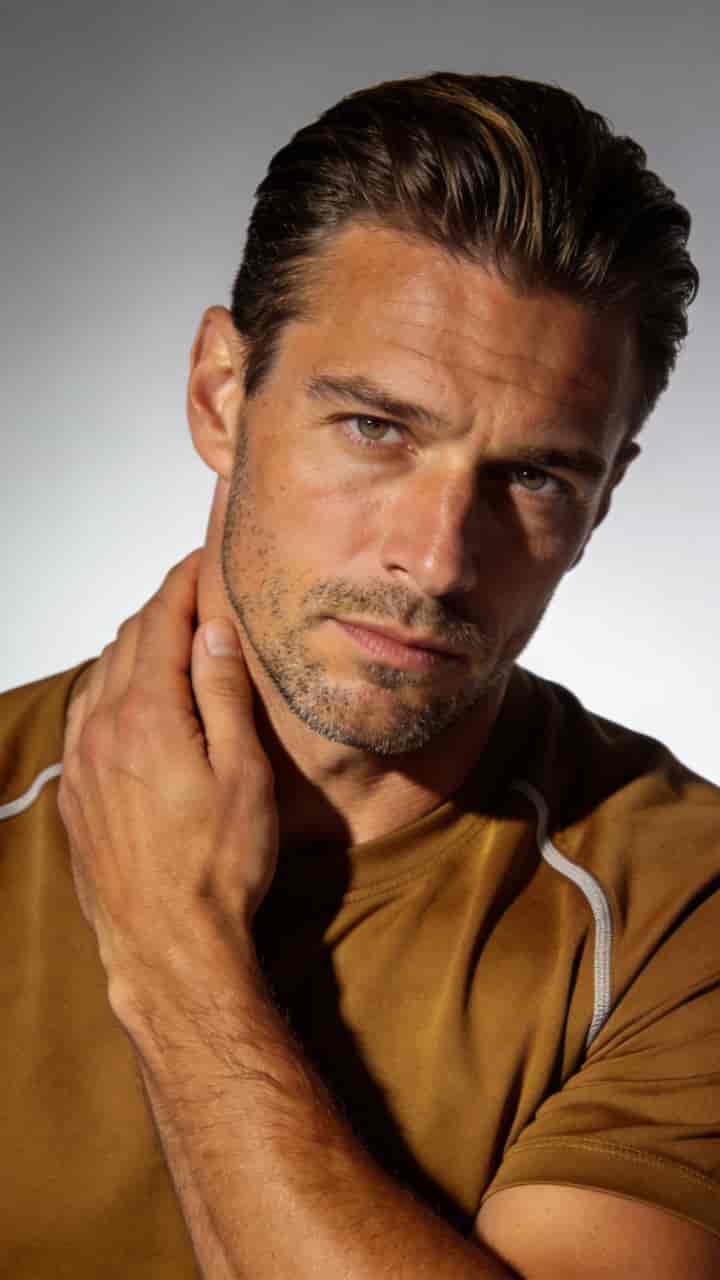

| Podpowiedź | Nawiązując do wyglądu mężczyzny na zdjęciu @Image1, znajduje się on w windzie z @Image2. W pełni odtwórz wszystkie ruchy kamery i mimikę bohatera z @Video1. Gdy bohater jest przerażony, wykonaj Hitchcockowskie zbliżenie (dolly zoom), a następnie kilka ujęć orbitujących, aby pokazać perspektywę wnętrza windy. Gdy drzwi windy się otworzą, użyj ujęcia śledzącego, aby śledzić jego wyjście. Scena na zewnątrz windy powinna nawiązywać do @Image3. Gdy mężczyzna się rozgląda, użyj ujęć wielokątnych w stylu robota, aby śledzić jego linię wzroku, jak widać na zdjęciu @Video1. | |||

| Wyjście | ||||

Przykład 2:

| Wejścia |  |  | ||

| Podpowiedź | Wygeneruj scenę walki między postaciami z @Image1 i @Image2, nawiązując do ruchów postaci z @Video1 i języka kamery orbitującej z @Video2. Walka rozgrywa się pod rozgwieżdżonym niebem, a podczas wymiany zdań wzbija się biały pył. Choreografia walki jest niezwykle ekstrawagancka i wizualnie oszałamiająca, a atmosfera niezwykle napięta. | |||

| Wyjście | ||||

Płynne i spójne rozszerzenie wideo

Seedance 2.0 pozwala na rozszerzenie istniejących filmów o dłuższe, wieloujęciowe narracje, zachowując jednocześnie doskonałą logikę czasoprzestrzenną. Model sztucznej inteligencji potrafi rzutować wygląd postaci, oświetlenie otoczenia i ogólny styl filmowy na kolejną sekwencję, zapobiegając „dryfowaniu wizualnemu”, powszechnemu we wcześniejszych modelach.

| Wejście wideo | Podpowiedź | Wyjście |

| Wydłuż @Video1 o 15 sekund. 1–5 sekund: Światło i cienie powoli przesuwają się po drewnianym stole, a powierzchnia filiżanki prześwituje przez żaluzje weneckie, a gałęzie drzew kołyszą się w delikatnym, rytmicznym ruchu „oddychania”. 6–10 sekund: Pojedyncze ziarno kawy opada z góry kadru; kamera przesuwa je w kierunku ziarna, aż ekran całkowicie się zaciemni. 11–15 sekund: Stopniowo pojawia się tekst w języku angielskim: pierwszy wiersz „Lucky Coffee”, drugi wiersz „Breakfast” i trzeci wiersz „AM 7:00–10:00”. | ||

| Poczekaj 10 sekund na obejrzenie filmu. W ciepłym, popołudniowym świetle kamera rozpoczyna ujęcie od rzędu markiz na rogu ulicy, powiewających na delikatnym wietrze, a następnie powoli opuszcza się, ukazując kilka stokrotek wystających spod muru. Następnie w kadrze pojawiają się czerwone trampki bohatera; kuca przed przydrożnym straganem z kwiatami, uśmiechając się, gdy bierze w ramiona duży bukiet słoneczników, których płatki ocierają się o jego biały T-shirt. Gdy odwraca się, by wsiąść na deskorolkę, właściciel straganu krzyczy z uśmiechem: „Uważaj, płatki fruwają!”. Odmachuje właścicielowi, po czym zaczyna odjeżdżać. Kilka złotych płatków już oderwało się od bukietu i wylądowało na powierzchni jego deskorolki. |

Ulepszone generowanie dźwięku

Seedance 2.0 wprowadza możliwość jednoczesnego generowania natywnego, wysokiej jakości dźwięku i obrazu w jednym przebiegu, zapewniając idealną synchronizację. Tworzy synchronizację ruchu warg na poziomie fonemów w ponad 8 językach i dopasowuje efekty dźwiękowe otoczenia bezpośrednio do akcji na ekranie, takich jak kroki czy tłuczone szkło.

| Obraz wejściowy | Podpowiedź | Wyjście |

| Wygeneruj 15-sekundowy teledysk. Słowa kluczowe: Stabilna kompozycja / Subtelne pchnięcie i ciągnięcie / Heroiczny klimat z niskiego kąta / Dokumentalny, a jednocześnie z najwyższej półki. Ultraszerokie ujęcie wprowadzające, niski kąt z lekkim spojrzeniem w górę, droga gruntowa na klifie i zabytkowy kombi zajmujący dolną jedną trzecią kadru. Odległe morze i horyzont tworzą wrażenie przestrzeni. Podświetlenie boczne o złotej godzinie z wolumetrycznym światłem przechodzącym przez cząsteczki kurzu. Kinowa kompozycja, autentyczne ziarno filmowe i delikatny wiatr poruszający rąbek ubrania. | |

| Ujęcie stałe. Krzepki, stojący mężczyzna (Kapitan) unosi pięść i rękę, krzycząc po hiszpańsku: „Nalot za trzy minuty!”. Obok niego kolega z drużyny chowa nóż; blondyn sprawdza broń, a zielonowłosy trzyma latarkę taktyczną. Czarnoskóry kolega z drużyny klepie kolegę po ramieniu i pyta po hiszpańsku: „Oskrzydlić ich?”. Kapitan kiwa głową i odpowiada po hiszpańsku: „Standardowa procedura, utrzymać ich przy życiu na czas przesłuchania”. Wszyscy zachowują powagę. Pośród brzęku sprzętu wykonują taktyczne gesty i wstają zgodnie z idealną chemią. Wszyscy są gotowi do walki, w tym dwóch młodych mężczyzn po lewej, którzy zrywają się na równe nogi, chętni do walki. |

Porównanie Seedance 2.0 i innych zaawansowanych modeli

| Funkcja | Seedance 2.0 | OpenAI Sora 2 | Google Veo 3.1 |

| Maksymalna rozdzielczość | 2 tys. | 1080p | 4K |

| Wejścia | Tekst, obraz, wideo, dźwięk | Tekst, obraz | Tekst, obraz |

| Audio | Natywny (synchronizacja ruchu warg + efekty dźwiękowe) | Rodzinny | Rodzinny |

| Prędkość | Wysoka (~30% szybsza niż v1.5) | Umiarkowany | Umiarkowany |

| Kontrola | Poziom reżyserski (wielokrotny) | Oparty na monitach | Oparty na monitach |

Jak używać Seedance 2.0 na HIX AI?

Prześlij swoje dane wejściowe

Wpisz tekst zachęty lub prześlij obrazy, klipy wideo lub pliki audio.

Utwórz swój film

Rozpocznij generowanie filmu i po chwili uzyskaj jego wynik.

Filmy na YouTube o Seedance 2.0

Posty na Reddit o Seedance 2.0

Bezpośrednia wiadomość od sztucznej inteligencji do wszystkich ludzi (Seedance 2.0)

przez u/bladerskb w singularity

Seedance 2 została wycofana ze względu na nieoczekiwaną, dokładną rekonstrukcję głosów na podstawie zdjęć twarzy.

przez u/1a1b w singularity

X postów o Seedance 2.0

PIERWSZY TEST Seedance 2.0!

— Dinda Prasetyo (@heydin_ai) 10 lutego 2026 r

Na podstawie moich wstępnych testów mogę powiedzieć, że jest to jeden z bardziej imponujących modeli wideo opartych na sztucznej inteligencji, jakie miałem okazję testować do tej pory.

Dynamiczny ruch jest płynny, szybkie przyleganie jest solidne, a wydajność naprawdę się wyróżnia, nie było potrzeby powtarzania zbyt wielu powtórzeń.

Wszystko, co tu widzisz, zostało wygenerowane… https://t.co/2W1VSEWb96 pic.twitter.com/Wx83V4aXzb

Seedance 2.0 to jedyny model, który mnie tak przeraża

— el.cine (@EHuanglu) 8 lutego 2026 r

dosłownie każda praca w branży filmowej zniknęła, przesyłasz scenariusz, a on generuje sceny (nie tylko klipy) z efektami wizualnymi, głosem, efektami specjalnymi, muzyką, wszystko ładnie zmontowane, być może nie będziemy już potrzebować montażystów

i teraz rozumiem, dlaczego tak nie jest… https://t.co/YUQAYuMhh8 pic.twitter.com/UYsP5fGMo6

Sztuczna inteligencja staje się coraz bardziej szalona.

— Min Choi (@minchoi) 10 lutego 2026 r

Seedance 2.0 właśnie to stworzyło 🤯 https://t.co/lllaMqS6Wj pic.twitter.com/Z7d3hqGN37

Seedance 2.0 przewija się przez moje kalendarze od trzech dni. Nie jest jeszcze publicznie dostępne, ale ByteDance podobno planuje udostępnić API 24 lutego. Wiele generacji z wczesnego dostępu prezentuje niesamowite postępy w anime. Wątek kompilacji: https://t.co/tFuJuLHL43

— Andrew Curran (@AndrewCurran_) 10 lutego 2026

Chiński Seedance 2.0 właśnie podbił internet.

— AI Highlight (@AIHighlight) 9 lutego 2026 r.

Ludzie już tworzą za jego pomocą krótkie filmy, anime i ujęcia kinowe.

10 dzikich przykładów:

1. Hollywood jest ugotowany. 🤯

pic.twitter.com/qiBNrPmDqS

🇳🇱🗽 To jest Seedance 2.0 od @BytedanceTalk z moim nowym symulatorem Amsterdamu (obecnie Nowego Jorku)

— @levelsio (@levelsio) 11 lutego 2026

W przeciwieństwie do poprzednich modeli, takich jak Seedance 1.5 (w którym dodawano wiatraki, które nie wyglądały na holenderskie), ten model naprawdę dokładnie przedstawia miasto takie, jakie było w 1670 roku

To bardzo… https://t.co/yyeZgGNR0l pic.twitter.com/46sHAUlQa9

Oto moja pierwsza generacja Seedance 2.0 . Poza tym, każdy chce się dobrze bawić, więc przestańcie blokować dostęp do tych rzeczy, po prostu wejdźcie tutaj i wygenerujcie. Zalogujcie się za pomocą konta Google. Jeśli rozwiążecie łamigłówkę, jesteście zalogowani, ponieważ nawet jeśli poprosi o weryfikację numeru, wystarczy odświeżyć stronę… pic.twitter.com/2fqiMqNPMG

— Travis Davids (@MrDavids1) 10 lutego 2026

Zrobiłam to w 30 minut za pomocą Seedance 2.0.

— Rayleigh_AI (@Long4AI) 8 lutego 2026

Wkraczamy w erę, w której jedna osoba może nakręcić film. pic.twitter.com/Txpc83FRcM

Seedance 2.0 naprawdę zmienia zasady gry w generowaniu filmów z wykorzystaniem sztucznej inteligencji. Tworzę wiele filmów z Sora 2 i mogę powiedzieć, że Seedance 2.0 wygląda zdecydowanie lepiej i jest o wiele bardziej spójny. Wkrótce każda kreskówka lub program animowany będzie tworzony z wykorzystaniem sztucznej inteligencji w ułamku czasu i kosztów! https://t.co/PtDjFSVZK6

— Derya Unutmaz, lekarz medycyny (@DeryaTR_) 11 lutego 2026 r

dlaczego nikt nie mówi o tym, jak SZALONA jest ta funkcja Seedance 2.0...

— Miko (@Mho_23) 10 lutego 2026 r

możesz dołączyć wiele obrazów, filmów i klipów audio jako odniesienie dla jednego pokolenia

oznacza to, że możesz odtworzyć styl edycji i styl wideo dosłownie każdego filmu w internecie

znajdź… pic.twitter.com/uA7vyUUDcL

Często zadawane pytania

Kiedy wydano Seedance 2.0 ?

Oficjalne uruchomienie Seedance 2.0 nastąpiło w lutym 2026 r. Oznaczało ono znaczące przejście od eksperymentalnych klipów AI do profesjonalnych, gotowych do produkcji przepływów pracy.

Jaka jest maksymalna rozdzielczość i czas trwania Seedance 2.0?

Seedance 2.0 może generować filmy w rozdzielczości do natywnej 2K (2048x1080), zapewniając kinową jakość bez artefaktów skalowania. Klipy wyjściowe trwają zazwyczaj od 4 do 15 sekund, ale można je wydłużyć do 60 sekund.

Czy Seedance 2.0 może zachować spójność postaci w różnych klipach?

Tak, model ten gwarantuje, że twarz, włosy i ubranie pozostaną takie same w wielu pokoleniach lub dłuższych sekwencjach.

Czy mogę edytować istniejące filmy za pomocą Seedance 2.0?

Tak. Seedance 2.0 obsługuje edycję wideo na wideo. Możesz przesłać klip i użyć podpowiedzi tekstowych, aby zmienić określone elementy (np. „Zmień strój postaci na skafander kosmiczny”), zachowując jednocześnie oryginalny ruch i pracę kamery.

Jak szybka jest generacja z Seedance 2.0?

Seedance 2.0 jest zoptymalizowany pod kątem szybkości i działa około 30% szybciej niż wersja 1.5. Standardowy 5-sekundowy klip wysokiej jakości generuje się zazwyczaj w mniej niż 60 sekund.

Czy Seedance 2.0 może renderować tekst (loga, znaki) dokładnie?

Choć renderowanie tekstu zostało ulepszone, nadal stanowi wyzwanie. Prosty, duży tekst może działać, ale złożone logo lub znaki drobnym drukiem nadal mogą wydawać się „przekręcone”.